Cos’è il quantum computing

Il quantum computing è, letteralmente, la computazione quantistica: la memorizzazione, l’elaborazione e la trasmissione elettronica delle informazioni secondo i principi della meccanica quantistica.

La meccanica quantistica è quella parte della fisica che descrive le interazioni tra materia ed energia nell’infinitamente piccolo, la dimensione delle particelle subatomiche.

È nata agli inizi del ‘900, a partire da problemi che la fisica classica non riusciva a spiegare, come l’emissione del corpo nero e l’effetto fotoelettrico: nel 1900 Max Planck ipotizzò che la radiazione elettromagnetica venisse assorbita dagli atomi non in modo continuo ma discreto, per pacchetti di energia chiamati “quanti”; nel 1905 Einstein dimostrò che le stesse onde elettromagnetiche fossero costituite da “quanti di luce” chiamate in seguito “fotoni”.

La quantizzazione dell’energia aprì la strada al primo modello dell’atomo proposto da Niels Bohr nel 1913 e allo sviluppo di un nuovo paradigma teorico “scandaloso” perché controintuitivo rispetto alla fisica classica e alla logica binaria.

I paradossi della meccanica quantistica

Nell’infinitamente piccolo, una particella può essere anche un’onda (dualismo onda-corpuscolo, De Broglie, 1924), non è possibile misurare entrambi gli aspetti nello stesso esperimento (principio di complementarità, Bohr, 1927), né determinare a priori, con precisione assoluta, i valori di due variabili incompatibili come la posizione e la quantità di moto di una particella (principio di indeterminazione, Heisenberg, 1927). Il comportamento di una particella elementare è prevedibile solo in modo probabilistico. Non è più applicabile il concetto di traiettoria classicamente inteso, né quello di misura.

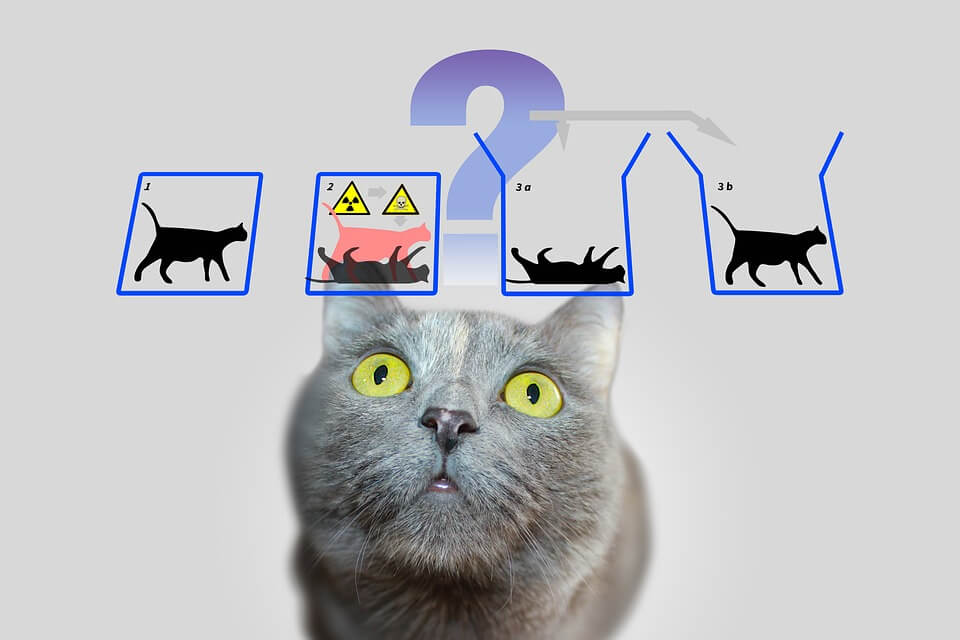

Infatti, nell’infinitamente piccolo, l’osservatore e gli apparati di misurazione perturbano e interagiscono con “l’oggetto” osservato: arriviamo al famoso paradosso di Schröedinger. Il padre della meccanica ondulatoria immaginò un gatto chiuso in una scatola con una fiala di cianuro, rotta da un martelletto in seguito alle radiazioni di un atomo di uranio: poiché per le leggi della meccanica quantistica non è possibile sapere quando l’atomo emetterà le radiazioni, e quindi quando il cianuro ucciderà il gatto, fino al momento dell’apertura della scatola (l’osservazione) il gatto sarà mezzo vivo e mezzo morto.

Se il gatto fosse stato una particella, avremmo detto “vivo e morto contemporaneamente”, per il principio della sovrapposizione di stati: infatti, un sistema quantistico può trovarsi contemporaneamente in due stati diversi, ognuno pesato da un coefficiente di probabilità. Non a caso, mentre nella fisica classica lo stato di un sistema è descritto da un punto, nella meccanica quantistica si usa il vettore.

Per l’interpretazione di Copenaghen il sistema in sovrapposizione “collassa” in uno stato definito al momento dell’osservazione-misura. Per la teoria della decoerenza, la sovrapposizione di stati non si osserva nei sistemi macroscopici, dove vige la fisica classica, perché il sistema quantistico non è isolato ma interagisce con l’ambiente esterno. Per la teoria a molti mondi, l’osservatore vede realizzarsi solo uno dei due stati perché lui stesso fa parte di uno solo dei possibili stati dell’Universo.

Le sfide del quantum computing

Il principio di sovrapposizione quantistico è alla base del qubit, l’unità di informazione del quantum computing: al contrario del bit, che può assumere solo valore zero o valore uno, il qubit può assumere contemporaneamente valore zero, uno e tutte le somme pesate tra loro, con un aumento esponenziale della potenza computazionale. Questi valori possono venire elaborati simultaneamente e in parallelo (parallelismo quantistico) solo se nel qubit viene mantenuta la sovrapposizione: se la particella “collassa” in uno stato, ad esempio per una qualsiasi interazione con l’ambiente, il calcolo non è più possibile.

L’allungamento del tempo di coerenza, ovvero del tempo in cui l’informazione quantistica rimane inalterata, è una delle maggiori sfide attuali del quantum computing. I qubit collegati tra loro possono provocare interferenze al passaggio dell’informazione, per cui è possibile che il numero di qubit di un computer quantistico diventi inversamente proporzionale al tempo di coerenza: più qubit collegati, più interferenza, meno coerenza.

L’altra sfida importante per il quantum computing è sfruttare al massimo l’entanglement, la correlazione tra due particelle, indipendente dalla distanza: conseguenza della sovrapposizione di stati quando si considera più di un sistema, l’entanglement si verifica quando è possibile definire matematicamente lo stato di una coppia ma non della singola particella. L’esempio è quello di due monete lanciate in aria, che roteano all’infinito mostrando entrambe le facce (sovrapposizione di stati): in caso di entanglement, se si compie una misura su una delle due e si ottiene croce, anche l’altra, istantaneamente, si posizionerà su croce. Quindi, agendo su una particella, si cambierà lo stato (il comportamento) anche dell’altra, con un’accelerazione importante del processo di computazione.

Video – Cosa è l’entanglement – FermiLab (inglese)

Cosa è la Quantum Supremacy e quali sono le ricerche in corso

Quando un computer quantistico riesce ad eseguire operazioni impossibili da effettuare in tempi ragionevoli per un computer classico, si parla di Quantum Supremacy. La supremazia quantistica ha anche risvolti geopolitici, per le potenzialità dei calcolatori non lineari in termini di cybersicurezza, simulazione dei mercati e transazioni digitali.

I qubit più diffusi sono quelli basati sui circuiti elettrici superconduttori: dei chip depositati su un cristallino di silicio e zaffiro che per rimanere isolati e funzionare devono essere portati a temperature vicine allo zero assoluto. Sono i qubit utilizzati da Google, IBM, Rigetti. Seguono i qubit basati su singoli atomi levitati in campi elettrici, chiamati trappole ioniche: sono usati da Honeywell, da startup come IonQ (su cui ha investito Samsung) e disponibili tra i servizi cloud di Amazon e Microsoft.

Il primo computer quantistico commerciale, a 128 qubit, è stato annunciato nel 2011 dall’azienda canadese D-Wave System, che nel 2013 ne ha venduto la seconda versione a 512 qubit al Quantum Artificial Intelligence Center della Nasa. La sua capacità di calcolo però, testata da ricercatori dell’Istituto Federale Svizzero di Tecnologia (ETH) con pubblicazione su Science, non sembra avere la potenza necessaria ad affrontare il carico progressivo di complessità di elaborazione che è caratteristica dei processori quantistici, il quantum speed-up.

A gennaio 2019 IBM ha presentato il proprio modello di computer quantistico commerciale, IBM Q System One, che può essere impiegato dalle aziende tramite cloud.

Nell’ottobre dello stesso anno Google ha confermato le indiscrezioni sul raggiungimento della supremazia quantistica e ha pubblicato uno studio su Nature in cui ha affermato che Sycamore, un processore quantistico a 54 qubit, ha risolto in tre minuti e 20 secondi un calcolo estremamente complesso, riguardante un problema statistico scelto con cura. IBM ha dichiarato che il proprio processore quantistico, Summit, potrebbe eseguire lo stesso calcolo di Sycamore in meno tempo. Nel proprio Quantum AI Lab, l’azienda di Mountain View ha creato un processore da 72 qubit, Bristlecone.

Video: Come Google ha dimostrato la Quantum Supremacy (inglese)

A dicembre 2020 il gruppo di ricerca quantistica leader in Cina ha pubblicato su Science i risultati di Quantum Supremacy raggiunti con Jiuzhang, un sistema quantistico basato su fotoni che viaggiano attraverso circuiti ottici disposti su un banco da laboratorio, guidati da specchi. Ogni fotone letto alla fine del processo può essere considerato più o meno equivalente alla lettura di un qubit su un processore come quello di Google. I ricercatori cinesi hanno calcolato che mentre Jiuzhang ha impiegato poco più di tre minuti, per misurare gli stessi fotoni il terzo supercomputer classico più veloce al mondo avrebbe richiesto più di 2 miliardi di anni. La velocità di campionamento misurata è circa 1014 volte maggiore rispetto a un processore standard.

L’Unione Europea dal 2018 ha lanciato la Quantum Flagship Initiative, di cui è partner il Consiglio Nazionale delle Ricerche: un miliardo di euro in 10 anni per finanziare studi sulle tecnologie quantistiche.

Video: Che cos’è la Quantum Flagship Initiative (inglese)

Il Department of Energy (DOE) degli Stati Uniti d’America, nell’ambito della National Quantum Iniziative, ha finanziato a fine agosto 2020 con 115 milioni di dollari il nuovo Quantum Materials and System Center (SQMS) con sede al Fermi National Accelerator Laboratory di Chicago. Il centro, diretto dall’italiana Anna Grassellino, che ha tra i 20 partner come unico non statunitense l’Istituto Nazionale di Fisica Nucleare, ha tra gli obiettivi quello di sviluppare in 5 anni un computer dalle prestazioni mai raggiunte. Il programma prevede la costruzione di un hardware che integri le cavità 3D superconduttive ultraefficienti utilizzate per la rilevazione di particelle con l’evoluzione dei transmon qubit 2D prodotti da Rigetti.

Video: Il Quantum Computer del SQMS (Inglese)

Con la cavità 3D ultraefficiente, i ricercatori del Fermi Lab hanno già stabilito il record mondiale di tempo di coerenza di un fotone, due secondi, e vorrebbero estenderlo, nel progetto, a decine di secondi. Il transmon qubit integrato nella cavità dovrebbe sfruttarne i livelli energetici non lineari per aumentare la potenza computazionale del processore. In seguito, è previsto il collegamento dei diversi moduli cavità-transmon inseriti in un apposito criostato alto 10 metri. Il primo prototipo è previsto nel 2023.

A cosa serve il quantum computing e quali sono le sue applicazioni

Il Quantum Computing serve a elaborare e risolvere problemi attualmente intrattabili con i computer classici per limiti di potenza e velocità di memorizzazione ed elaborazione.

Basato sui principi che regolano la fisica subatomica, il Quantum Computing può fornire un grosso contributo nella simulazione del comportamento naturale delle particelle, quindi delle molecole: può quindi aiutare, ad esempio, le ricerche sulla materia oscura dell’universo o la progettazione di nuovi farmaci. Uno dei problemi più difficili che in futuro un computer quantistico potrebbe aiutare a risolvere è il protein folding, il ripiegamento molecolare attraverso cui le proteine ottengono la loro struttura tridimensionale.

Il 28 agosto 2020 i ricercatori del Laboratorio AI Quantum di Google hanno pubblicato su Science i risultati della prima simulazione di una reazione chimica di una molecola di 4 atomi compiuta con il processore quantistico Sycamore.

Il team Quantum di IBM è stato contattato dalla Mitsubishi Chemical e dalla Keio University per modellare e studiare il meccanismo di riordino del superossido di litio, un passaggio chimico decisivo per produrre batterie agli ioni di litio e ossigeno, che in teoria dovrebbero essere più leggere e andare più lontano con una singola carica di quelle tradizionali. Lo stesso team sta lavorando con Daimler AG, la casa madre della Mercedes-Benz, per lo sviluppo di batterie al litio-solfo ad alta densità di energia.

Video: Il Futuro del Quantum Computing – IBM (Inglese)

Simulare il comportamento delle molecole chimiche può portare anche a sviluppi nell’ambito della sostenibilità e dell’efficienza energetica, con nuovi catalizzatori o meccanismi che inneschino la cattura dell’anidride carbonica su larga scala, ottimizzino la rete elettrica di un paese o identifichino modelli ambientali più predittivi: la multinazionale dell’energia Exxon Mobil sta collaborando con IBM Quantum per coprogettare nuovi scenari grazie al calcolo quantistico.

La potenza di calcolo e la velocità di un computer quantistico associate al machine learning possono spingere ad un’evoluzione importante della progettazione e dell’addestramento di reti neurali artificiali, del riconoscimento di modelli, della rilevazione di anomalie statistiche, della classificazione di dati non strutturati. A cascata, questo ha applicazioni sulla logistica (sistemi di controllo del traffico, sistemi di controllo della rete elettrica), il marketing, la finanza.

Da gennaio 2021 Machine Learning Reply, la società del gruppo Reply specializzata in soluzioni AI, lavorerà con Airbus per testare sul campo l’algoritmo con cui ha vinto la Airbus Quantum Computing Challenge e che dovrebbe permettere ad un aereo di identificare la disposizione e la capacità ottimale dei carichi attraverso diversi parametri e vincoli fisici come il peso massimo e il centro di gravità dell’aeromobile stesso. Calcoli complessi per capacità di carico ottimizzate.

A dicembre 2020 i ricercatori di IBM e Goldman Sachs hanno pubblicato un articolo, “A Threshold for Quantum Advantage in Derivative Pricing” per verificare il vantaggio quantistico nel pricing dei derivati, uno dei calcoli più comuni nella finanza. Su computer classici, il calcolo viene eseguito attraverso “simulazioni di Montecarlo”. L’obiettivo di eseguire simulazioni casuali delle variazioni di prezzi dei beni nel tempo richiede enormi quantità di potenza di calcolo. Attraverso algoritmi quantistici preformati, è stato individuato un metodo di “ri-parametrizzazione” per ridurre il fabbisogno di risorse necessarie.

La finanza punta sul calcolo quantistico per ridurre i tempi necessari ad analizzare posizioni di rischio complesse, ottimizzare i portafogli di investimento, individuare più rapidamente le anomalie di mercato.

La potenza e la velocità del Quantum Computing possono essere applicate anche nell’ambito che attualmente rende sicure le transazioni finanziarie digitali, la crittografia. Blockchain compresa.

Crittografia quantum safe, quantistica e post-quantistica

Ogni transazione inserita in una blockchain si basa sulla crittografia asimmetrica, con chiavi diverse per cifrare e decifrare il messaggio. Tra i più comuni metodi utilizzati, l’algoritmo di crittografia a chiave pubblica RSA, acronimo delle iniziali dei cognomi dei suoi tre inventori, Ronald Rivest, Adi Shamir e Leonard Adleman.

L’algoritmo RSA prevede che sia la chiave pubblica che la chiave privata contengano un numero che è il prodotto di due numeri primi piuttosto grandi, che solo chi ha generato le chiavi conosce. Si basa quindi sulla fattorizzazione, ovvero sulla scomposizione in fattori primi di un numero intero (es. semplificato: 15=3×5). Dalla chiave pubblica, teoricamente, è possibile risalire alla chiave privata trovando i fattori primi che le compongono. L’algoritmo basa quindi la sua sicurezza sulla difficoltà degli attuali elaboratori di fattorizzare numeri a molte cifre in un tempo ragionevole (si parla di milioni di anni).

Nel 1994, il matematico americano Peter Shor ha inventato un algoritmo quantistico in grado di farlo: fattorizzare in tempi ragionevoli numeri a molte cifre, trovare i numeri primi che le compongono, ottenere le chiavi di accesso al codice e poter leggere “in chiaro”.

Nel 2015, è stato calcolato che un computer quantistico avrebbe avuto bisogno di un miliardo di qubit per riuscire a decriptare in modo affidabile un modulo RSA a 2048 bit. Nel 2019, la stima è scesa a 20 milioni di qubit. Ancora lontano dagli attuali 72 qubit raggiunti, ma se si riuscisse a costruirlo nei prossimi 20 anni?

Un altro metodo comune di firma digitale utilizzato nella blockchain è ECDSA – Elliptic Curve Digital Signature Algorithm, l’algoritmo di firma digitale a curva ellittica. Si basa sulla risoluzione del problema del logaritmo discreto ma, secondo le stime, potrebbe essere decriptabile con la metà dei qubit necessari per l’RSA.

Il punto non è quindi se, ma quando un computer quantistico sarà abbastanza potente da poter accedere ai codici e decriptare i messaggi e le transazioni trasmesse con i principali codici crittografici.

Da anni si stanno sviluppando diversi metodi di crittografia quantum safe, crittografia quantistica e post-quantistica. Mentre crittografia “Quantum Safe” e crittografia “post-quantistica” pongono l’accento su metodi che “resistano” ad eventuali attacchi di elaboratori quantistici, la crittografia quantistica utilizza gli stessi principi del Computing per progettare sistemi “all’altezza” dei processori.

L’agenzia statunitense NIST- National Institute of Standards and Technology ha avviato nel 2017 la Post Quantum Cryptography Standardization, una call per progetti in grado di sviluppare standard di crittografia post-quantistica. Le 69 proposte ricevute si sono ristrette a 26 nel 2019 e a 15 nel 2020. Le categorie della call sono “standardizzazione di primitive di cifrature a chiave pubblica e di key-establishment” e “standardizzazione per algoritmi di firma digitale”. I risultati finali dovrebbero essere resi noti nel 2023. Gli algoritmi avrebbero comunque bisogno di un computer quantistico adeguato per poter essere testati.

Video: Considerazioni sul passaggio agli algoritmi di crittografia post – quantistica (inglese) – NIST

Un altro esempio di ricerca sulla crittografia Quantum Safe, che vede coinvolta, tra gli altri, IBM, è la Lattice-based Cryptography, la crittografia basata su reticoli, griglie bidimensionali di punti su cui costruire problemi matematici impossibili da risolvere in tempi ragionevoli anche per i processori quantistici.

Video: Cos’è la crittografia su reticoli – University of Michigan (Inglese)

La crittografia quantistica, ovvero la crittografia che utilizza la meccanica quantistica, non si basa su problemi algebrici o geometrici difficili da risolvere ma sul sistema quantistico come chiave crittografica. Un bit è costituito da un fotone polarizzato.

Il 21 aprile 2004 è stata effettuata una transazione di denaro tra la Bank Austria Creditanstalt e il municipio di Vienna usando fotoni “entangled”, correlati tra loro a distanza. Un laser ha colpito un cristallo per dividere due singoli fotoni in altre due parti, ottenendo due coppie entangled. Attraverso una fibra ottica, un fotone di ogni coppia è stato inviato dalla banca al municipio: una volta a destinazione, è stato osservato il loro stato di polarizzazione, che corrisponde in uno schema prestabilito ad una cifra binaria, zero o uno. Sia l’emittente che il destinatario hanno avuto a disposizione lo stesso dato, come le due estremità di un filo, che con l’interferenza di un osservatore terzo sarebbe cambiata inequivocabilmente.

Infatti, per il principio di indeterminazione di Heisenberg, sappiamo che l’osservatore perturba sempre l’oggetto osservato: se si conosce la misura di un sistema quantistico già osservato da qualcuno (in questo caso, la coppia di fotoni entangled), l’eventuale interferenza di un osservatore terzo perturberebbe il sistema e sarebbe immediatamente rilevata. Il sistema quantistico diventa la chiave crittografica.

La Quantum Key Distribution (QKD), la distribuzione quantistica delle chiavi crittografiche, è l’esempio più famoso di crittografia quantistica, che permette a due soggetti di ottenere chiavi sicure attraverso l’invio di fotoni opportunamente polarizzati su un canale quantistico.

Video: Come funziona la QKD? Centre for Quantum Technologies – Singapore

Nel mondo, ci sono quattro società che offrono sistemi commerciali di QKD: ID Quantique a Ginevra, MagiQ Technologies Inc a New York, QuintessenceLabs in Australia e SeQureNet a Parigi.

L’Unione Europea sta finanziando il progetto OpenQkd – Open Quantum Key Distribution, che dal 2019 ha l’obiettivo di creare e testare una infrastruttura di rete di comunicazione che integri la QKD. Con un budget di 15 milioni di euro, il progetto ha un consorzio di 38 partner coordinati dall’Austrian Institute of Technology e durerà fino a settembre 2022. Le soluzioni saranno testate in settori strategici come le telecomunicazioni, la sanità o la distribuzione di energia elettrica per sviluppare un ecosistema europeo che lavori sugli standard dell’infrastruttura. L’Italia partecipa al progetto con il gruppo di ricerca QuantumFuture del Dipartimento di Ingegneria dell’Informazione dell’Università di Padova.

A dicembre 2019, è stato effettuato in Italia il primo test di crittografia quantistica da CNR e Laboratorio Europeo di Spettroscopia Non lineare (Lens) di Firenze, attraverso la fibra ottica di 1800 chilometri che collega Torino a Matera: il primo passo verso l’Italian Quantum Backbone (IQB), la rete italiana di comunicazione quantistica ad elevati standard di sicurezza.

Quantum Machine Learning e Dynamic Quantum Clustering

Il Quantum Computing è rivoluzionario sotto tutti gli aspetti del trattamento delle informazioni: memorizzazione, elaborazione, trasmissione. I Big Data si chiamano così perché hanno volumi così estesi da richiedere tecnologie e metodi analitici specifici per poter estrarne valore in un tempo ragionevole: il loro tasso di crescita incrementale è già una sfida per i computer classici, chiamati a gestire mole di dati sempre più grandi. Una sfida che i computer quantistici a regime potrebbero affrontare in tempi ridotti e maggiore efficacia.

Non a caso, si moltiplicano gli studi sul Quantum Machine Learning, l’apprendimento automatico su elaboratori quantistici. Attraverso il Machine Learning, la macchina “apprende” dai dati attraverso algoritmi artificiali, supervisionati o meno, per il riconoscimento di pattern, ovvero di schemi ricorrenti.

Video: Introduzione al Quantum Machine Learning – Corso MOOC – University of Toronto

Nel 2016 ricercatori americani hanno pubblicato su Nature uno studio che dimostra come non serva un computer quantistico di grandi dimensioni per affrontare matematicamente alcuni problemi topologici applicati a big data.

La topologia è la branca della matematica che studia le proprietà delle forme geometriche che rimangono costanti anche quando la figura viene allungata, girata, deformata ma non lacerata: per la topologia, una ciambella e una tazza di caffè con il manico sono equivalenti, perché l’una può essere trasformata nell’altra senza strappi, sovrapposizioni o incollature.

Una tazza di caffè che si trasforma in un toroide – Wikimedia

L’algoritmo quantistico trovato dai ricercatori apre scenari interessanti per l’analisi di reti complesse come le reti neurali e i grafi dei social network.

Nel 2018, uno studio dell’Università di Pavia, ripreso dal MIT Technology Review, ha dimostrato che un neurone artificiale può essere implementato in modo efficace su un processore quantistico: il primo passo verso la costruzione di reti neurali artificiali quantistiche, che accelerano esponenzialmente la velocità dell’algoritmo di apprendimento.

Le reti neurali artificiali sono infatti tra i principali algoritmi di apprendimento supervisionato, ovvero condotto sotto la supervisione umana.

Il dato “nuovo” viene ricondotto a categorie note cui erano stati associati i dati della fase di addestramento: il processo viene detto classificazione ed è stato dimostrato che gli algoritmi di classificazione a pattern quantistici siano più performanti di quelli attuali. È stata inoltre individuata la versione quantistica di un classificatore ad albero decisionale, e su piccoli dati la versione quantistica supera i metodi di classificazione classici.

Tra i metodi di apprendimento non supervisionato più usati nel machine learning c’è il clustering, il raggruppamento dei dati in ingresso in cluster, gruppi con caratteristiche simili: attraverso un’analisi statistica multivariata, il clustering mira a scoprire proprietà già presenti nei dati a disposizione. Il Dynamic Quantum Clustering è un metodo visivo, sviluppato dai fisici David Horn e Marvin Weinstein nel 2009: gli algoritmi utilizzano le variazioni della densità dei dati nello spazio delle caratteristiche per trovarne i sottoinsiemi e come risultato dell’analisi multivariata producono un’elaborazione video che mostra le correlazioni individuate.

Video: Cosa è il Dynamic Quantum Clustering – Marvin Weinstein – Google Talk

Il Quantum Machine Learning, in parte già disponibile attraverso servizi in cloud, sta migliorando le ricerche sull’AI nonché i modelli di simulazione di sistemi complessi: dalle particelle, alle molecole, ai mercati finanziari, ai grafi sociali, alle reti di produzione e distribuzione di energia e di ottimizzazione del traffico.

Morgan Stanley stima che il mercato dei computer quantistici di fascia alta arriverà quasi a raddoppiare entro il 2025, raggiungendo i dieci miliardi di dollari l’anno. La promessa del Quantum Computing di cambiare il modo attraverso cui riusciamo a descrivere il mondo e farne previsioni ha una portata rivoluzionaria. Più di 100 anni dopo la nascita della meccanica quantistica, e il relativo cambio di paradigma scientifico, i tempi sembrano maturi per una “messa a terra” delle sue implicazioni. Il viaggio è iniziato.